AMD发布最新Instinct MI350系列GPU,AI计算提升4倍,推理提升35倍

发布时间:

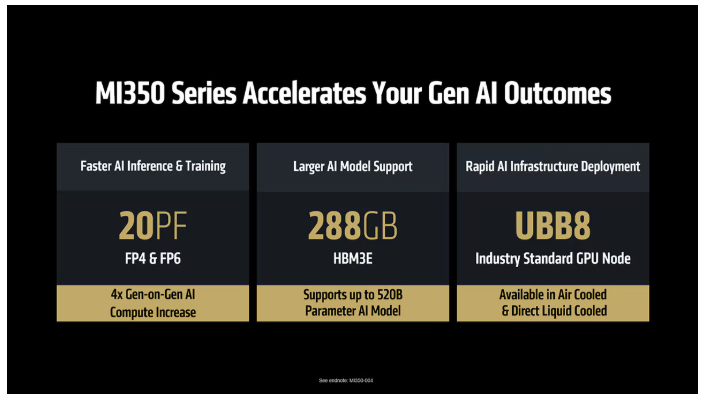

6月13日消息,AMD在2025全球AI发展大会上发布了最新Instinct MI350系列GPU,实现了4倍的AI计算能力提升和35倍的推理性能飞跃,是其在AI芯片领域的又一次重大突破。

据悉,该系列GPU基于全新的CDNA 4架构,采用台积电3nm工艺制造,晶体管数量高达1850亿个,相比前代产品显著提升。MI350系列包括两个主要型号:MI350X(风冷)和MI355X(液冷),其峰值功耗分别为1000W和1400W,支持风冷和直液冷两种散热设计。

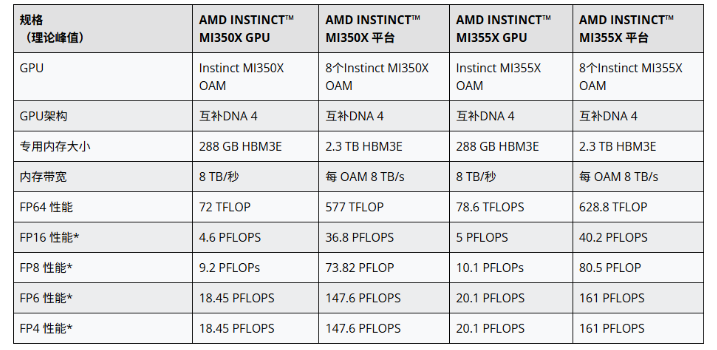

Instinct MI350系列规格

与上一代MI300X系列相比,MI350系列实现了4倍的AI计算能力提升,推理性能提升了35倍。

在性能方面,Instinct MI350系列GPU支持128条HBM3E内存通道,每颗HBM3E的单颗容量提升至36GB,总体内存容量达到288GB,内存带宽提升至8TB/s。此外,该系列GPU在支持FP8、FP16精度的基础上,新增支持FP4和FP6低精度格式,更好地满足现代AI推理任务需求。

在算力方面,MI355X的FP64算力达到79TFLOPS,FP16达到5PFLOPS,FP8达到10PFLOPS,算力是MI325X的近4倍。同时,MI355X新增支持的FP4、FP6算力高达20PFLOPS。

在能效方面,Instinct MI350系列GPU在功耗不加倍的情况下实现了双倍计算吞吐量的提升,内存带宽和本地数据共享进一步支持更高的计算吞吐量。此外,该系列GPU在经济性方面也表现出色,相比NVIDIA B200,每美元生成的Token最多增加40%。

该公司还透露了其下一代AMD Instinct MI400系列——性能更上一层楼,将于2026年上市。AMD Instinct MI400系列将代表性能的显著飞跃,为大规模训练和分布式推理提供全机架级解决方案。关键性能创新包括:

·高达432GB的HBM4内存

·19.6TB/s内存带宽

·FP4时为40 PF,FP8时为20 PF性能

·300GB/s横向扩展带宽

“Helios”AI机架式基础设施将于2026年推出,其全新设计旨在将AMD领先的芯片——AMD EPYC“Venice”CPU、Instinct MI400系列GPU和Pensando“Vulcano”AI NIC——以及ROCm软件整合到一个完全集成的解决方案中。Helios被设计为一个统一的系统,支持紧密耦合的纵向扩展域,最多可容纳72个MI400系列GPU,纵向扩展带宽高达260 TB/秒,并支持Ultra Accelerator Link。

值得一提的是,OpenAI联合创始人兼首席执行官Sam Altman作为特邀嘉宾出席了本次大会。此前,在研发的过程中,OpenAI一直为AMD提供技术反馈,帮助其优化GPU。奥尔特曼表示,将使用AMD的MI300X和MI450 AI芯片。

AMD首席执行官苏姿丰还透露,公司将在2027年推出基于MI500的AI服务器。